Nvidia dự kiến doanh thu đạt 1 nghìn tỷ USD vào năm 2027 khi nhu cầu về chip trí tuệ nhân tạo (AI) của hãng tiếp tục tăng, bất chấp những nghi ngại về quá trình xây dựng cơ sở hạ tầng AI quy mô lớn này sẽ kéo dài bao lâu.

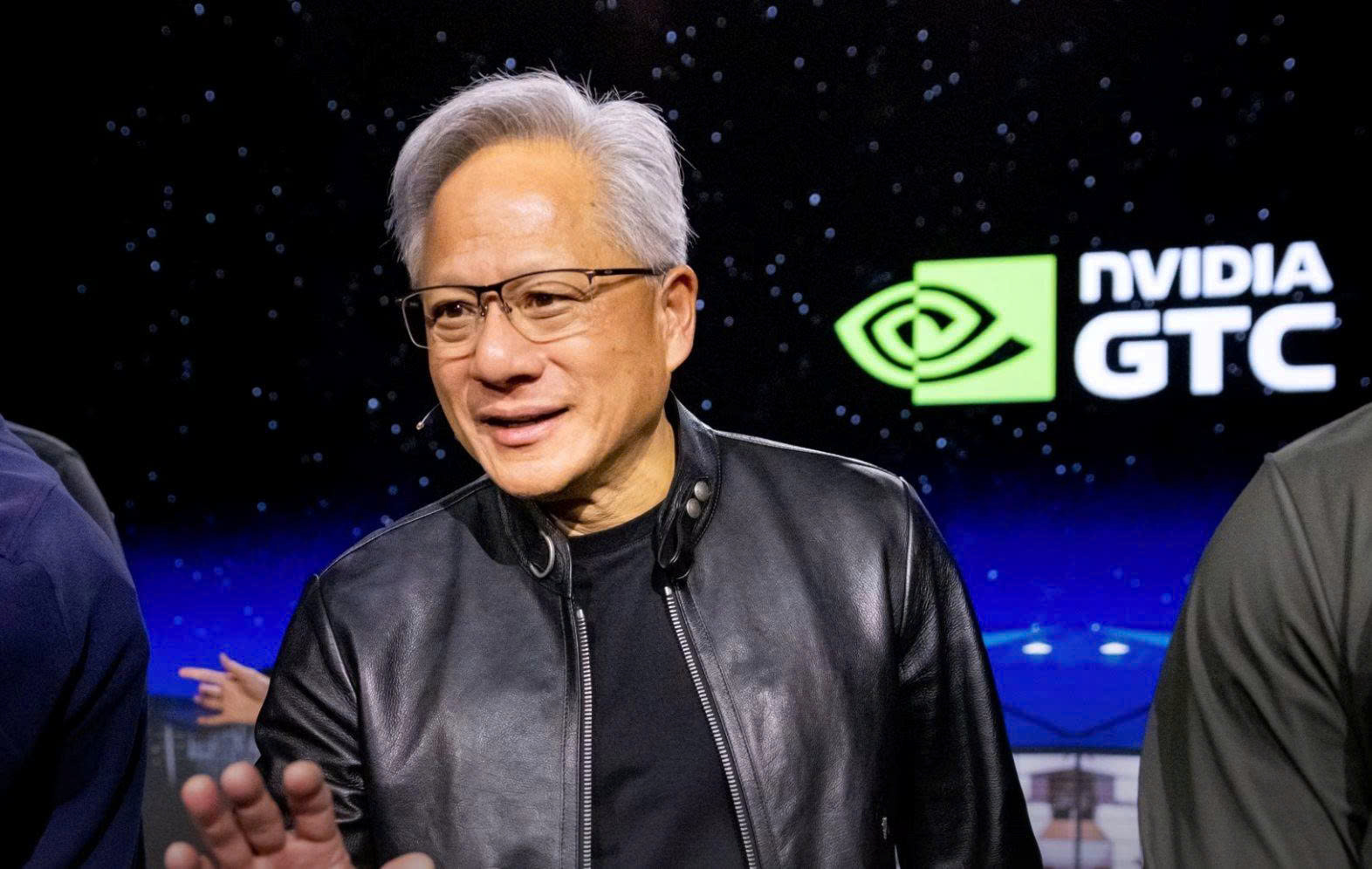

Tại hội nghị nhà phát triển thường niên GTC của công ty ở Washington, D.C. (Mỹ) vào tháng 10/2025, Giám đốc điều hành (CEO) Nvidia, Jensen Huang, nói rằng công ty dự kiến doanh thu đạt 500 tỷ USD từ các sản phẩm Blackwell và Rubin trong năm 2025 và 2026.

Khai mạc hội nghị hôm 16/3 tại San Jose (California), vị CEO công nghệ nổi tiếng, trong chiếc áo khoác da đen thường thấy, đã nâng dự báo doanh thu lên 1 nghìn tỷ USD vào năm 2027 khi nhu cầu điện toán (AI computing) tiếp tục gia tăng, đặc biệt là đối với suy luận AI (AI inference) hay triển khai các mô hình AI.

Tích cực

"Cuối cùng, AI đã có thể làm việc hiệu quả. Do đó, bước ngoặt của AI inference đã đến," ông Huang nói, đồng thời nhấn mạnh thêm rằng điều này đang làm tăng nhu cầu AI computing lên "khoảng 10.000 lần."

CEO Jensen Huang gây phấn khích khi đưa ra dự báo cơ hội doanh thu từ chip AI có thể đạt ít nhất 1.000 tỷ USD vào năm 2027. Ảnh: Nikkei Asia.

Do nhu cầu ngày càng tăng đối với AI inference - sử dụng các mô hình AI để thực hiện các nhiệm vụ - Nvidia, vốn đã thống lĩnh thị trường chip được sử dụng trong huấn luyện AI, cũng đang tìm cách chiếm lĩnh thị trường triển khai AI. Hôm 16/3, công ty công bố một hệ thống AI mới kết hợp chip AI Vera-Rubin thế hệ tiếp theo của hãng với bộ xử lý AI inference chuyên dụng của Groq.

Groq là một startup chuyên về chip AI được Nvidia đầu tư 20 tỷ USD vào cuối năm 2025.

Trong khi Nvidia thống trị thị trường huấn luyện AI, nhiều nhà sản xuất chip khác như Groq đang nhắm đến thị trường AI inference.

Công bố mới từ CEO Nvidia lập tức tạo hiệu ứng tích cực trên thị trường, giúp cổ phiếu Nvidia tăng 1,6% trong phiên giao dịch cùng ngày.

Chip Groq do Samsung sản xuất

Đáng chú ý, tại GTC 2026, Nvidia đã tích hợp LPU Groq 3 vào hệ thống AI Vera Rubin NVL72 của mình, đánh dấu lần đầu tiên công ty sử dụng chip computing AI không phải của Nvidia trong hệ thống máy chủ.

Bộ xử lý ngôn ngữ (LPU) của Groq là một kiến trúc chip được thiết kế đặc biệt cho giai đoạn AI inference của các mô hình ngôn ngữ lớn, có độ trễ thấp và khả năng tính toán cao.

Chip AI inference mới của Groq mới sẽ do nhà máy đúc của Samsung sản xuất, một thắng lợi lớn cho nhà sản xuất chất bán dẫn Hàn Quốc vì các chip AI tiên tiến nhất của Nvidia vốn do Tập đoàn Sản xuất Chất bán dẫn Đài Loan (TSMC) sản xuất.

Ông Huang cho hay chip Groq do Samsung sản xuất sẽ bắt đầu được xuất xưởng vào nửa cuối năm nay.

Hơn 30.000 người tham dự hội nghị GTC thường niên của Nvidia tại San Jose tuần này. Ảnh: Nikkei Asia.

Nvidia cũng đang bị cuốn vào cơn sốt OpenClaw. Gã khổng lồ chip này đang ra mắt một loạt bộ công cụ để xây dựng các AI agent (tác nhân AI) "tự tiến hóa" với trọng tâm là bảo mật tại sự kiện GTC thường niên ở San Jose.

OpenClaw, nền tảng AI mã nguồn mở, cho phép người dùng tạo ra các "claw" (móng vuốt) khác nhau, hay các tác nhân AI tự động có thể thực hiện các nhiệm vụ phức tạp như đàm phán giá cả qua email hoặc cải thiện mã phần mềm với rất ít hoặc thậm chí không cần con người "nhúng tay vào".

Khả năng này đã gây ra cơn sốt lớn với cả cá nhân bình thường và các công ty AI trong việc ứng dụng các AI agent. Điều này cũng gây ra lo ngại ở Trung Quốc, khi Bắc Kinh cảnh báo về rủi ro bảo mật khi cho phép các tác nhân AI do phương Tây phát triển truy cập không kiểm soát vào hệ thống máy tính.

(Theo Nikkei Asia)